北邮王啸:图神经网络的两面性(2)

【作者】网站采编

【关键词】

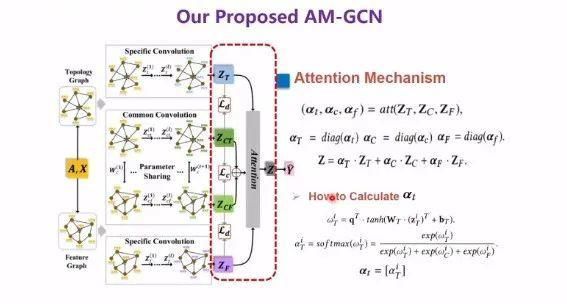

【摘要】图 5:AM-GCN 的注意力机制 我们通过注意力机制,动态地调整拓扑结构信息、特征结构信息、公共结构信息对最终的融合表征的贡献,自适应地学习出最适

图 5:AM-GCN 的注意力机制

图 5:AM-GCN 的注意力机制

我们通过注意力机制,动态地调整拓扑结构信息、特征结构信息、公共结构信息对最终的融合表征的贡献,自适应地学习出最适用于下游任务的表征。

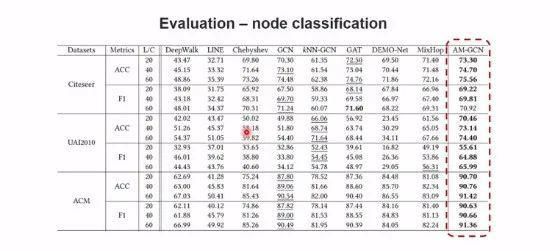

图 6:实验结果

图 6:实验结果

实验结果表明,使用针对拓扑结构的 GCN 和使用特征结构的 kNN-GCN 时的模型性能不分伯仲,因此特征结构也具有很大的信息量。

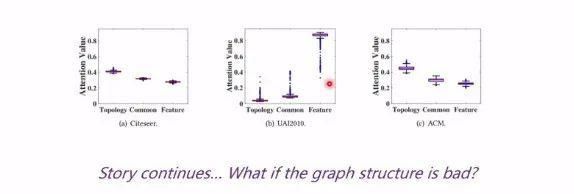

图 7:实验结果

图 7:实验结果

通过对注意力进行分析,我们发现有时拓扑结构更重要,有时特征更重要。

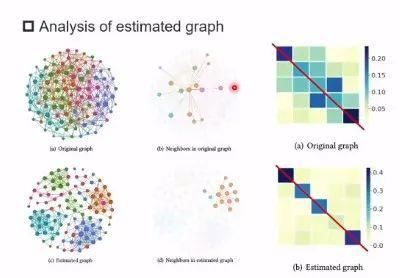

图 8:图结构估计神经网络

图 8:图结构估计神经网络

上面的工作对特征结构利用进行了一定探索。然而,拓扑图本身也可能存在噪声或缺失,或不能很好地适用于下游的任务。为此,我们进一步提出了一种图结构评估网络,希望能够自动学习一种更适合图神经网络的图结构。

我们认为,好的图结构应该具有以下三点性质:

(1)站在巨人的肩膀上:充分利用网络科学和图数据科学的研究成果,将真实世界中图所具有的基本特征、先验信息利用起来。

(2)兼听则明,偏听则暗:在单一的度量方式下得到的结构可能存在偏差,图上的结构需要在多种度量下都成立。

(3)知己知彼,百战不殆:图结构的学习过程应该与图神经网络联系在一起。

我们通过贝叶斯框架将上述三个性质的引入统一为后验概率最大化问题,并使用 EM 算法对其进行求解。从贝叶斯框架的角度来看,第一个性质提供了先验信息;第二个性质通过观测结果推测图的结构,实际上提供了似然信息。在拥有先验信息和似然信息的情况下,自然地将上述问题转化为后验概率最大化问题。

图 9:实验结果

图 9:实验结果

如图 9 所示,针对仿真数据上包含较多噪声的原始数据,我们可以利用拓扑图的结构,以及根据图神经网络的嵌入学习到的不同阶邻居的观测信息,最终得到如图 9 左下角所示的图结构。

2

如何利用其它频段的信息

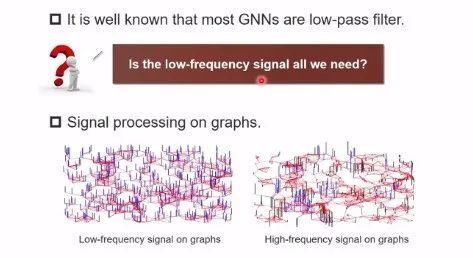

目前,许多研究者已经证明,大部分的 GNN 相当于一种低通滤波器。那么,一个自然的问题是,我们是否需要利用低频信号之外的信息?应该如何利用?

图 10:如何利用低频信号之外的信息

图 10:如何利用低频信号之外的信息

如图 10?所示,图中各节点较为一致的信号为低频信号,图中节点之间差异较大的信号为高频信号。为了研究不同频段信号的作用,我们分别考虑同配性(节点与邻居较为相似)图和异配性(节点与邻居差异较大)图。

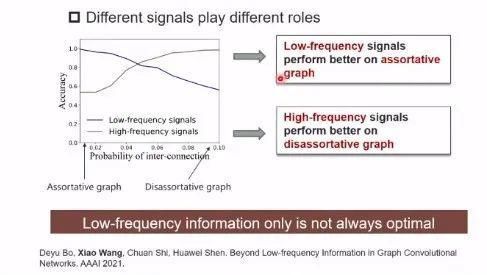

图 11:不同信息的作用

图 11:不同信息的作用

针对仿真数据,我们可以通过一系列调整,使图数据逐渐从同配性较高变化为异配性较高,并且在该过程中分别观察使用低频信号和高频信号对最终模型准确率的影响。实验结果表明,低频信号在同配性高的图上性能较好,而高频信号在异配性高的图上性能较好。

基于上述发现,我们提出两点思考:(1)如何在 GNN 中使用不同频段的信号?避免传统的 GNN 将低频信号之外的信号屏蔽掉。(2)我们往往缺乏对图的同配性/异配性程度的先验知识。如何自适应地选择合适的频段信号处理目标图数据?

传统的 GNN 在不考虑邻居节点相似度的条件下仅仅保留低频信息。但是我们希望节点保留相似邻居节点的低频信息,并且保留不相似邻居节点的高频信息,从而使网络具有更好的判别性。此外,由于缺乏对图的同配性/异配性程度的先验知识,我们希望能够自动判断保留邻居节点的低频信息还是高频信息。

如图 12 所示,我们提出的 FAGCN 模型可以自适应地提取最合适的频段的信息,在各种实验设定下能够获得稳定的高准确率。

图 12:FAGCN

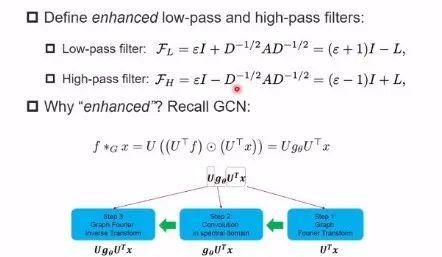

具体而言,我们设置了两个增强的滤波器:

增强的低通滤波器为:

增强的高频的滤波器为:

图 13:两种增强的滤波器

图 13:两种增强的滤波器

如图 13 所示,对 GCN 而言,给定图信号 x,我们通过拉普拉斯矩阵的特征向量 U 将 X 变换到某种需要的频率下,并使用形为对角矩阵的参数在该频率下对信号进行滤波(即增强或抑制信号)。在该参数矩阵中,较大的元素可以增强对应的信号,较小的元素可以抑制对应的信号。最后,我们通过图傅里叶逆变换将信号转换回空域。

文章来源:《北京邮电大学学报》 网址: http://www.bjyddxxb.cn/zonghexinwen/2021/0724/756.html